IT-Systeme: Warum Vertrauen für Unternehmen so wichtig ist

Vertrauen ist gut, Kontrolle ist besser. Diesen Spruch kennen wir noch alle – vor allem auch im Hinblick auf die IT. Doch was ist, wenn wir die IT-Systeme nicht mehr kontrollieren können? Dann müssen wir einfach vertrauen, auch wenn es schwerfällt. Was Unternehmen tun sollten, damit dies für ihre Nutzern möglichst einfacher ist, lesen Sie im nachfolgenden Artikel.

In verschiedenen Studien, zum Beispiel der Zukunftsstudie 2020 vom Münchner Kreis, wurde konstatiert, dass Mitarbeiter eher dazu geneigt sind, den Analysen und Handlungsempfehlungen einer Künstlichen Intelligenz (KI) zu folgen als auf die Expertise ihrer Kollegen zu vertrauen. Dies mag auf einer simplen Einschätzung basieren. Eine Analyse mittels KI wird als objektiver beziehungsweise neutraler eingestuft, weil ja – zumindest theoretisch – keine (unberechenbaren) persönlichen Emotionen bei diesem Prozess eine Rolle spielen. Sondern die Analyse der vorhandenen Daten findet auf rein mathematischem Wege statt. Auch die Tatsache, dass man viel mehr Daten berücksichtigt und somit in die Entscheidung einfließen können, lässt eine Analyse oder eben auch Handlungsempfehlung ausgereifter erscheinen. Denn all diese Parameter will und kann ein Kollege auch gar nicht erfüllen.

Doch wie ist es überhaupt möglich, dass Menschen annehmen, sich darauf verlassen zu können, eine abstrakte KI-Anwendung wäre dazu in der Lage, bessere Lösungskonzepte zur Verfügung zu stellen? Eine Grundvoraussetzung dafür ist, dass mit der Anwendung von KI-basierten Diensten und Produkten per se das Versprechen eines Mehrwerts für den Nutzer einhergeht. Als weitere Prämisse muss gegeben sein, dass man ein Nutzer in die Lage versetzt, seine grundsätzliche Vertrauensfähigkeit auf KI-Systeme zu extendieren. Das kann ermöglicht werden, indem es gelingt, interpersonelles Vertrauen – das heißt das Vertrauensverhältnis, das aufgrund verschiedener Kriterien zwischen Menschen entsteht und von daher im Prinzip nachvollziehbar ist – auf KI-Systeme zu übertragen, obwohl deren Verhalten nicht unbedingt nachprüfbar ist.

Begriffsbestimmung Vertrauen und Vertrauenswürdigkeit

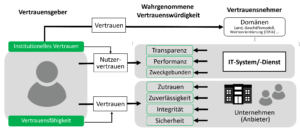

Um diesen Vorgang zu verstehen, erscheint es erst einmal notwendig die Begriffe ‚Vertrauen‘ und ‚Vertrauenswürdigkeit‘ einzuführen und voneinander abzugrenzen. Vertrauen kann als Bereitschaft eines Vertrauensgebers definiert werden, sich durch die Interaktion mit einem Vertrauensnehmer einem bestimmten Risiko auszusetzen [1]. Somit gilt Vertrauen als hoffungsvoller Vorschuss hinsichtlich bestimmter Erwartungen eines Nutzers. Vertrauenswürdigkeit hingegen basiert auf der Annahme, dass es möglich ist, sich auf etwas Bestimmtes verlassen zu können. In den meisten Fällen beruht die wahrgenommene Vertrauenswürdigkeit auf offensichtlichen Attributen des Vertrauensnehmers, die dem Vertrauensgeber durch den ersten Eindruck, aus vergangenen Interaktionen oder über Dritte bekannt sind [2]. In Ergänzung dazu ist es mittlerweile essentiell, dass Unternehmen Aspekte der Vertrauenswürdigkeit explizit darzustellen.

Warum wir den KI-Systemen gar nicht vertrauen können, es aber doch tun

Vorab: Im Prinzip ist es nicht möglich einem KI-System zu vertrauen, da letztendlich von dem jeweiligen KI-System weder der Beweis erbracht werden kann, dass es stets im besten Interesse des Nutzers handelt, noch dass es keine seiner Schwächen ausnutzt.

Ausgehend von diesem Grundgedanken, stellt die Verwendung einer Technologie, eines Dienstes oder einer Anwendung theoretisch für den Menschen immer eine Risikohandlung dar. Daraus ergibt sich die Frage, was gewährleistet sein muss, damit sie trotzdem zum Einsatz kommt. Schlüssig erscheint hierfür die Prämisse der Vertrauenswürdigkeit, die es seitens der Anbieter – als Vertrauensnehmer – aufzuweisen und auch zu beweisen gilt. Daran zeigt sich einerseits die Relevanz von Vertrauen bei der Nutzung von innovativen Technologien und unterstreicht gleichzeitig die Notwendigkeit, dass Unternehmen vertrauenswürdig agieren müssen, damit das gewährte Vertrauen auch gerechtfertigt ist.

Soweit die Theorie. Doch anhand bestimmter Kriterien lässt sich diese sowohl näher definieren als auch beleuchten, was dieses Konstrukt in der – sowie für die – vernetzte(n) Wissens- und Informationsgesellschaft bedeutet.

Vertrauen heißt in erster Linie Zutrauen

Ein relevantes Kriterium für die Vertrauenswürdigkeit ist Zutrauen. Generell kann man dieses im Hinblick auf die Funktionalität dadurch erzeugen, dass Hersteller und Diensteanbieter sowohl über die Fähigkeit als auch über die entsprechenden Mittel verfügen. Dadurch kann man eine verlässliche sowie sichere Technologie, respektive Dienste und Anwendungen, bereitstellen.

Obwohl diese Anforderung von hoher Bedeutung ist, wurde sie bis dato keinesfalls immer optimal erfüllt, da die zur Verfügung gestellten Technologien bislang aus verschiedenen Gründen nicht konstant ordnungsgemäß funktionierten. Dies hat teilweise zur Folge, dass Nutzer innovative Technologien per se infrage stellen. Daher liegt es an den Herstellern eine Vorgehensweise sowie ein Konzept zu entwerfen, um dieses Kriterium nicht nur erfüllen, sondern auch dokumentieren zu können.

Vertrauen bedeutet Zuverlässigkeit

Mit Zuverlässigkeit ist gemeint, dass Technologien sowie Lösungen nur die Dinge ausführen, die seitens der Nutzer gewünscht beziehungsweise die man erwartet und dies möglichst hundertprozentig zuverlässig. Zuverlässigkeit impliziert somit, dass Unternehmen per se wohlwollend sind und im besten Sinne ihrer Nutzer handeln, das heißt sich an deren Bedürfnissen orientieren, anstatt auf ihre eigenen Interessen zu fokussieren. Zum Beispiel, indem sie die Schwächen ihrer Nutzer nicht instrumentalisieren und so vermeiden, ihnen Schaden zuzufügen.

Momentan gibt es jedoch weder eine reglementierte Produkthaftung noch ein wahrnehmbares Verantwortungsbewusstsein seitens der Technologiekonzerne, wie es beispielsweise in der Automobil-Branche gang und gäbe ist. Das heißt, es ist möglich Anwendungen und Dienste zu offerieren, die nicht zwangsläufig einen normierten Grad an Zuverlässigkeit bieten. Um dieses Defizit zu beheben, müssen Hersteller Mechanismen integrieren, mittels derer sie den Grad der Zuverlässigkeit optimieren und im Weiteren dann darstellen können.

Vertrauen benötigt auch Integrität

Integrität zeigt sich darin, dass man seitens der Hersteller und Diensteanbieter alle Faktoren berücksichtigt, die jeweils die relevanten Aspekte der Vertrauenswürdigkeit beinhalten und hier insbesondere die ethischen Dimensionen beachtet. Das bedeutet, dass der Hersteller als Vertrauensnehmer alle Versprechen, die er gegeben hat, überhaupt prinzipiell einhalten kann und auch tatsächlich einhält sowie generell dazu bereit ist, sowohl Normen als auch Werte der Nutzer zu berücksichtigen.

Aktuell ist dies nicht durchweg der Fall, da oftmals noch das Geschäftsmodell „Bezahlen mit persönlichen Daten“ präferiert wird. Daraus lässt sich schlussfolgern, dass Hersteller und Diensteanbieter den Wert von Reputation und Glaubwürdigkeit nur als zweitrangig einstufen – das heißt letztendlich nicht im notwendigen Maße dazu bereit sind, durch eine ethische Vorgehensweise Verantwortung für das Allgemeinwohl der Gesellschaft zu übernehmen. Da diese Haltung zukünftig seitens der Gesellschaft nicht mehr unbedingt toleriert werden wird [3], sollten Unternehmen expressis verbis ihre ethischen Werte formulieren und veröffentlichen, um den Aspekt der Integrität adressieren zu können, um so ihre Vertrauenswürdigkeit aufzubauen.

Vertrauen baut auf Sicherheit

Mit Sicherheit ist gemeint, dass Technologien, respektive Dienste und Anwendungen, im Internet risikoarm zu nutzen sind. Dieser Anspruch ist jedoch (noch) eine Fiktion da Ransomware, DDoS oder Phishing heute an der Tagesordnung sind. Alltäglich genutzte Dienste, wie etwa E-Mail-Programme oder Online-Banking, haben bei weitem nicht den Level an Vertrauenswürdigkeit der notwendig ist, um kritische Geschäftsprozesse damit sicher abwickeln zu können. Insbesondere private Nutzer sind mit den Sicherheitsproblemen überfordert. Sie haben oft kaum Chancen und Möglichkeiten sich adäquat zu verhalten, weil sie nicht genau wissen, wie sie sich angemessen schützen können. Von daher benötigen Unternehmen ein adäquates IT-Sicherheitskonzept, um die Sicherheitsanforderungen im Sinne ihrer Nutzer umsetzen zu können.

Die kurze Analyse der Vertrauenswürdigkeitskriterien belegt, dass ein Vertrauen in Technologien, Anwendungen und Dienste prinzipiell noch nicht uneingeschränkt gerechtfertigt ist. Hier die notwendigen Voraussetzungen zu schaffen, mittels derer sich ihr Grad an Vertrauenswürdigkeit steigern lässt, bedeutet für Hersteller und Diensteanbieter, dass sie ihre Strategie künftig deutlich modifizieren und nach außen transportieren müssen, um Vertrauen aufzubauen.

Warum Unternehmen ihre Strategie überdenken müssen

Obwohl es auf den ersten Blick unlogisch erscheint, vertrauen heute viele Menschen den Plattformen, die sie nutzen – aber nicht den jeweiligen Anbietern. Dies resultiert in erster Linie daraus, dass der originäre Zweck des Dienstes die Zufriedenheit der Nutzer erfüllt. Das heißt, insbesondere bei Social Media-Kanälen, dass der Nutzer darüber die Möglichkeit hat mit Personen seines Vertrauens zu kommunizieren, das heißt in erster Linie ein interpersonelles Vertrauensverhältnis besteht. Desweiteren entsteht, abgeleitet ein interpersonales Vertrauen (Nutzervertrauen) dadurch, dass der besagte Dienst stets einwandfrei funktioniert, beispielsweise besteht die Möglichkeit, eine Nachricht immer genau zum gewünschten Zeitpunkt posten zu können und dass diese auch in der vorgegebenen Form veröffentlicht wird.

Das so erworbene Vertrauen kann seitens der Nutzer im Weiteren problemlos auf das Unternehmen, das den Dienst anbietet, übertragen werden. Doch darauf lässt sich kein solides Geschäftsmodell aufbauen, da vor allem die Qualität der Variablen ‚interpersonelles Vertrauen‘ allein von der Beurteilung der Nutzer abhängt. Dadurch ist deren Verhalten volatil und kann sich auch aufgrund marginaler Gegebenheiten kurzfristig ändern, so wird dann zum Beispiel ein lange genutzter Messaging-Dienst einfach durch einen alternativen ersetzt.

Ein Vertrauensverhältnis zu den Nutzern aufbauen

Um dem entgegenzuwirken, müssen Unternehmen aktiv daran arbeiten, qua ihrer Vertrauenswürdigkeit ein Vertrauensverhältnis zu ihren Nutzern aufzubauen. Dies lässt sich jedoch nicht durch das Einhalten von Gesetzen erreichen. Denn im Prinzip können Diensteanbieter zwar ihre Nutzer dazu verleiten allen AGBs zuzustimmen, um so datenschutzkonform mit den persönlichen Daten agieren zu können, doch erreicht man dadurch eher das Gegenteil. Vor allem, wenn dies mit dem Hintergedanken geschieht allgemeine Grundrechte wie beispielsweise das Recht auf Privatsphäre zu missachten, wie dies im Cyber-Raum momentan geschieht.

Wenn folglich Unternehmen tatsächlich eine dauerhafte Geschäftsbeziehung anstreben und als Vertrauensnehmer die damit einhergehende Verantwortung ernst nehmen, sollten Geschäftsmodelle zukünftig auf Transparenz basieren und eine Digital Ethik verfolgen, die den Menschen in den Mittelpunkt der Technologie stellt. Zu hinterfragen sind dann unter anderem Geschäftsmodelle wie „Bezahlen mit persönlichen Daten“, denn dieses birgt große Risiken für die Persönlichkeitsrechte und infiltriert die Daten-Souveränität der Menschen.

Was ist der Wert der Vertrauenswürdigkeit?

Ein Modell der Vertrauenswürdigkeit lässt sich folgendermaßen charakterisieren: Wenn ein Vertrauensnehmer sich, gemäß der relevanten Kriterien – etwa Integrität – dauerhaft vertrauenswürdig verhält, bietet er dem Vertrauensgeber eine stabile Grundlage dafür, Vertrauen aufzubauen. Dieses Vertrauen muss man jedoch nicht nur auf der Ebene des Unternehmens ausbilden und entsprechend rechtfertigen, sondern auch die Ebene des angebotenen KI-Systems einschließen.

Das bedeutet: Die Werteorientierung des Unternehmens allein genügt nicht für eine dauerhaft vertrauenswürdige Beziehung – diese Haltung muss sich auch in den Produkten widerspiegeln. Zum Beispiel indem Hersteller und Diensteanbieter sowohl die beste Absicht als auch die Fähigkeit haben, (im besten Sinne des Nutzers) sowohl zweckgebundene, performante als auch sichere Technologie, respektive Dienste und Anwendungen, zur Verfügung zu stellen sowie sich zur Transparenz zu verpflichten.

(Theoretisch) ist ein konkreter Mehrwert für alle Beteiligten nachweislich gegeben. Definitiv kann davon ausgegangen werden, dass sich mithilfe eines guten Vertrauensverhältnisses die Kundenloyalität erhöhen lässt. Zudem trägt jedes einzelne Unternehmen, das sich vertrauenswürdig verhält, dazu bei, das grundsätzliche Vertrauen in die Technologie (Domäne) – und insbesondere auch in die KI – zu stärken. Dadurch wird es insgesamt möglich, die Akzeptanz für die Nutzung neuer Technologien zu erhöhen. Aber auch für den Nutzer erwachsen daraus Vorteile – in einem etablierten Vertrauensverhältnis entfällt für ihn die dauernde Überprüfung dahingehend, ob er – zum Beispiel bei der Nutzung eines Dienstes – eine risikobehaftende Handlung begeht. Hat er mit einem Anbieter gute Erfahrungen gemacht, schätzt er Kauf und Nutzung eines neuen Produkts des gleichen Herstellers nicht als risikobehaftete Handlung ein.

Fazit

Anhand bestimmter Kriterien lässt sich die Vertrauenswürdigkeit von Unternehmen und deren Technologie näher definieren und auch, was Vertrauen faktisch bedeutet. Auf der Grundlage von Vertrauenswürdigkeit können die Nutzer Vertrauen aufbauen und so steigert sich die Akzeptanz für die Nutzung.

Natürlich klingt das in der Theorie nicht nur logisch, sondern auch als problemlos durchzusetzbar. Tatsächlich ist es jedoch empfehlenswert, dass Unternehmen hier einen Schritt weitergehen und sich damit auseinandersetzen, wie sie ihre Vertrauenswürdigkeit durch Umsetzung der relevanten Kriterien nachweisen können.

Lesen Sie weiter in unserer Artikelserie „Künstliche Intelligenz“:

Teil 1: Warum Vertrauenswürdigkeit und KI unbedingt zusammengehören

Teil 2: IT-Systeme: Warum Vertrauen für Unternehmen so wichtig ist

Teil 3: So lässt sich Vertrauenswürdigkeit für KI-basierte Anwendungen schaffen

[1] vgl. hierzu Gambetta, 1988; Johnson-George & Swap, 1982

[2] hierzu Nils Backhaus, Dissertation: Nutzervertrauen und -erleben im Kontext technischer Systeme: Empirische Untersuchungen am Beispiel von Webseiten und Cloudspeicherdiensten, 2016

[3] vgl. hierzu Andy Jassy: Der Mann, der hinter Jeff Bezos aufräumen muss, Handelsblatt, 6. Juli 2021 https://www.handelsblatt.com/technik/it-internet/amazon-andy-jassy-der-mann-der-hinter-jeff-bezos-aufraeumen-muss/27388456.html?ticket=ST-2849275-mtpouSgypq4e9QVPvWgd-ap4

Foto/Thumbnail: ©istockphoto/AndreyPopov

Kommentare